Vos données viennent de 15 sources différentes.

Aucune ne parle le même langage.

ERP, CRM, fichiers Excel, APIs, bases héritées : chaque source a son format, ses anomalies, ses doublons. Diskod conçoit et opère vos pipelines d’intégration pour transformer ce chaos en un référentiel unique, fiable et automatisé.

Sans intégration, vos données sont un puzzle sans image

Des données fragmentées génèrent des décisions fragmentées.

Doublons et incohérences

Le même client existe 4 fois dans votre système avec 4 orthographes différentes. Les stocks ne correspondent pas entre l’ERP et le WMS. Chaque rapport est une loterie.

Intégrations manuelles fragiles

Des macros Excel, des copier-coller, des imports CSV à la main. Un collaborateur absent et tout le processus s’arrête. Chaque étape manuelle est un risque d’erreur.

Silos de données

Chaque département a sa base, son fichier, son outil. Impossible d’avoir une vue 360° du client ou de l’activité. L’information circule par email quand elle circule.

Qualité non maîtrisée

Sans règles de validation automatiques, les erreurs de saisie, les formats incohérents et les valeurs aberrantes polluent tous vos rapports et analyses.

L’intégration data en chiffres

Notre offre collecte & traitement

Des pipelines robustes pour unifier, nettoyer et distribuer vos données automatiquement.

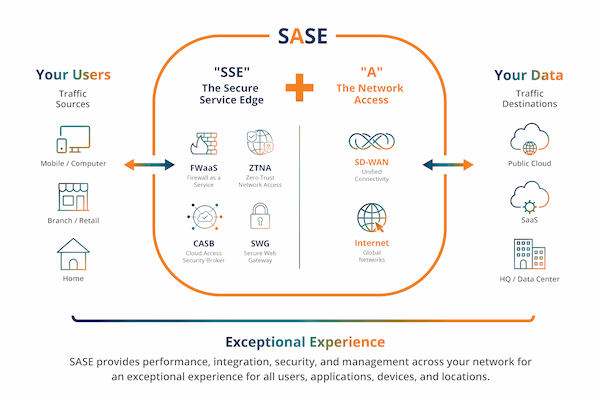

Connecteurs multi-sources

Intégration de vos ERP (SAP, Sage, Dynamics), CRM, bases SQL, APIs REST, fichiers plats, Google Sheets et sources cloud.

ETL / ELT automatisé

Pipelines d’extraction, transformation et chargement avec Azure Data Factory, Talend ou Airbyte. Orchestration et scheduling automatisés.

Nettoyage & dédoublonnage

Règles de validation automatiques, détection des anomalies, standardisation des formats et dédoublonnage intelligent par fuzzy matching.

Référentiel unique (MDM)

Construction d’un Master Data Management pour garantir une version unique de la vérité : clients, produits, fournisseurs, références.

Temps réel & streaming

Pipelines de streaming avec Kafka ou Azure Event Hubs pour les cas d’usage nécessitant une fraîcheur de données en temps réel.

Qualité & monitoring

Tableaux de bord de qualité des données, alertes sur les anomalies, SLA de fraîcheur et traçabilité complète (data lineage).

Notre approche en 4 étapes

Cartographie des sources

Inventaire exhaustif de vos sources, formats, volumes et fréquences. Identification des flux critiques et des zones de risque.

Architecture des pipelines

Conception des flux ETL/ELT, choix des outils, définition des règles de transformation et de qualité.

Développement & tests

Implémentation des pipelines, tests de qualité, validation avec vos équipes et mise en production progressive.

Monitoring & évolution

Surveillance 24/7 des pipelines, gestion des incidents, ajout de nouvelles sources et optimisation continue.

Nos autres expertises données & analyse

L’intégration est le socle d’un écosystème data performant.

BI, Tableaux de bord & Visualisation

Dashboards interactifs Power BI, KPI temps réel et self-service analytics.

Découvrir →

Data Lakes / Data Warehouses

Centralisation sur Azure Synapse, Snowflake avec modélisation dimensionnelle.

Découvrir →

Solutions Big Data

Spark, Databricks, architectures distribuées pour données massives.

Découvrir →

Visualisation de données

Dataviz interactive, storytelling et graphiques avancés.

Découvrir →« Nos commerciaux saisissaient les commandes dans 3 systèmes différents. Diskod a unifié tout ça en un référentiel unique. Les erreurs de facturation ont chuté de 85% et nos clôtures mensuelles prennent 2 jours au lieu de 8. »— Youssef Alaoui, DSI, Tanger Med Logistique (Tanger)

Questions fréquentes — Collecte & Traitement

ETL (Extract-Transform-Load) transforme les données avant le chargement. ELT charge d’abord puis transforme dans le data warehouse. L’ELT est privilégié avec les plateformes cloud modernes (Snowflake, BigQuery) car il exploite leur puissance de calcul.

Absolument. Nous avons l’expérience des ERP anciens (AS/400, Sage 100, Ciel, systèmes sur mesure). Via des connecteurs ODBC, des exports CSV automatisés ou des APIs sur mesure, nous intégrons même les systèmes les plus anciens.

Nous mettons en place des règles de validation dès la saisie (contraintes de format, listes de valeurs), des contrôles automatiques dans les pipelines (seuils, complétude), et des dashboards de qualité pour le suivi continu.

Du batch quotidien au temps réel, tout est possible selon votre besoin. Les pipelines batch tournent généralement de nuit. Pour le temps réel, nous utilisons Kafka ou Azure Event Hubs avec une latence de quelques secondes.

Azure Data Factory, Talend, Airbyte (open source), Apache NiFi, dbt pour la transformation, Great Expectations pour la qualité. Le choix dépend de votre écosystème et de votre budget.

Chaque pipeline intègre des mécanismes de retry, d’alerte et de dead-letter queue. En cas d’échec, notre équipe est notifiée immédiatement et intervient selon les SLA définis. Aucune donnée n’est perdue.

Vos données méritent mieux que des copier-coller.

Nos experts cartographient vos flux gratuitement et vous proposent une architecture d’intégration sur mesure.